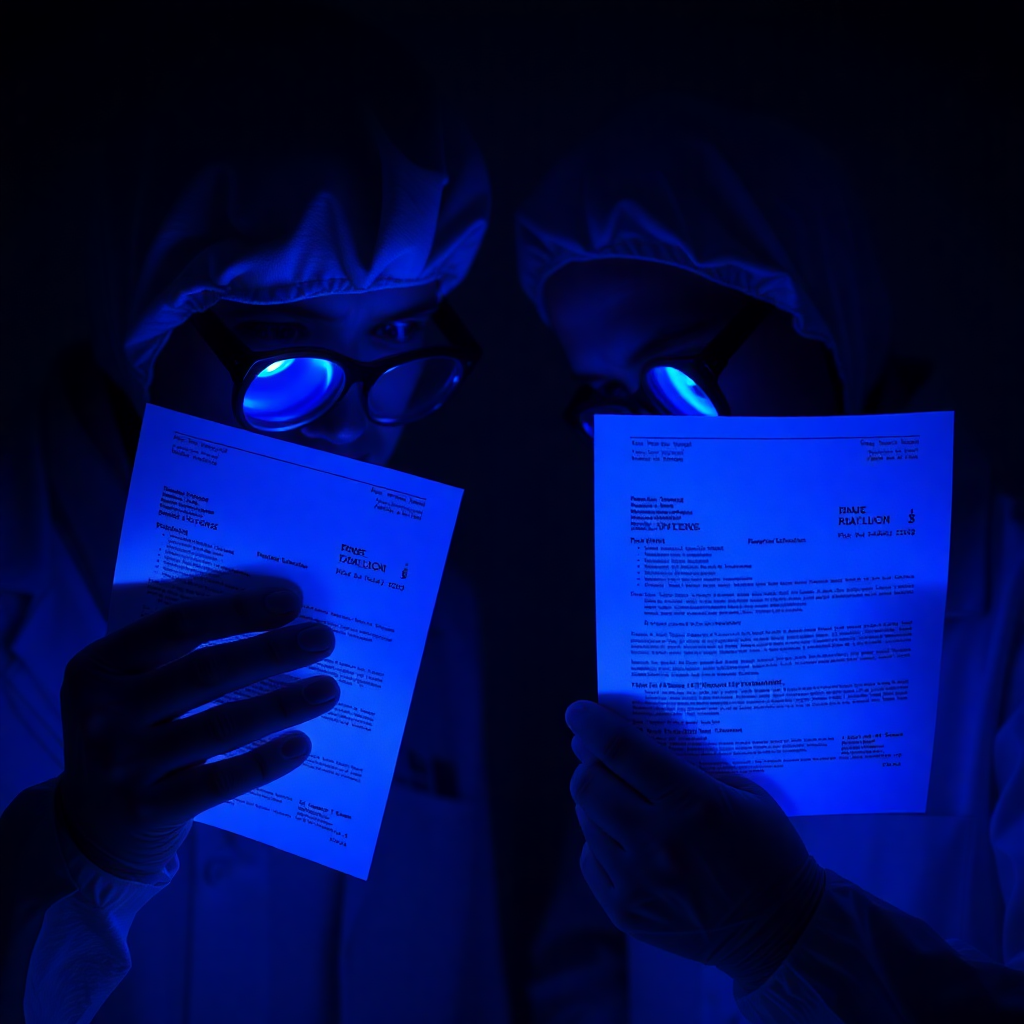

Détection IA : pourquoi même les experts se trompent

Quand la machine écrit mieux que l'homme… et que personne ne le voit

Un email de votre collègue. Un article de presse. Une lettre de motivation. Un rapport d'expert. Et si tout cela avait été rédigé par une intelligence artificielle ? Vous ne le sauriez probablement pas. Et ce n'est pas faute d'essayer : même les spécialistes les plus aguerris peinent aujourd'hui à distinguer un texte humain d'un texte généré par IA. Bienvenue dans l'ère du flou textuel.

Un problème qui dépasse largement les salles de classe

On a d'abord parlé de triche scolaire. Puis les inquiétudes se sont élargies aux médias, aux entreprises, aux tribunaux, aux campagnes politiques. La question de l'authenticité des textes est devenue un enjeu civilisationnel à part entière.

Depuis le lancement de ChatGPT fin 2022, les modèles de langage ont connu une progression fulgurante. Aujourd'hui, des outils comme GPT-4, Claude ou Gemini produisent des textes d'une fluidité, d'une cohérence et d'une richesse stylistique qui rivalisent — voire surpassent — la moyenne des productions humaines. Le problème n'est plus de savoir si l'IA peut écrire. C'est de savoir si on peut encore le détecter.

Pourquoi les détecteurs automatiques échouent

Face à cette déferlante, une industrie entière de détecteurs s'est développée : GPTZero, Originality.ai, Copyleaks, ou encore le détecteur d'OpenAI lui-même — que la firme a finalement retiré en raison de son taux d'erreur trop élevé. Car c'est là que le bât blesse.

Ces outils reposent principalement sur deux métriques :

- La perplexité : mesure à quel point un texte est "prévisible" pour un modèle de langage. Un texte IA est théoriquement plus prévisible qu'un texte humain.

- La "burstiness" : les humains varient naturellement la longueur et la complexité de leurs phrases. Les IA tendent à être plus régulières.

En théorie, c'est solide. En pratique, les résultats sont décevants. Des études ont montré que ces détecteurs génèrent jusqu'à 30 % de faux positifs — c'est-à-dire qu'ils accusent des textes humains d'avoir été écrits par une machine. Pire encore : un simple passage dans un outil de paraphrase suffit souvent à tromper les détecteurs.

Les experts humains ne font pas mieux

On pourrait croire que l'œil humain expert compense là où les algorithmes défaillent. Ce serait une erreur de jugement.

Une étude publiée dans la revue PLOS ONE a soumis des textes mélangés à des enseignants universitaires, des journalistes et des chercheurs en linguistique. Le taux de détection correcte ne dépassait pas 55 % — à peine mieux que le hasard. Les participants avaient tendance à juger les textes IA comme "trop parfaits" tout en échouant à identifier les véritables indices.

Pourquoi ? Parce que nos critères intuitifs de détection sont biaisés. On associe encore l'IA à la rigidité, à la répétition, aux formules creuses. Mais les modèles récents ont intégré l'imperfection comme feature. Ils introduisent délibérément des hésitations, des tournures idiomatiques, des erreurs légères. L'imitation de l'imperfection humaine est devenue une stratégie de camouflage.

Des cas concrets qui font froid dans le dos

Les implications ne sont pas théoriques. Elles sont déjà là :

- En 2023, un avocat américain a soumis des plaidoiries entièrement rédigées par ChatGPT, citant des jurisprudences inexistantes. Il ne les avait pas vérifiées.

- Plusieurs médias ont publié des articles générés par IA sans le signaler, avant d'être contraints à des rectifications publiques.

- Dans l'enseignement supérieur, des étudiants ont été sanctionnés pour avoir soumis des travaux humains… détectés à tort comme produits par une IA.

Vers quelles solutions se tourner ?

La détection parfaite est probablement une chimère. Mais cela ne signifie pas l'impuissance totale. Plusieurs pistes émergent :

- Le watermarking : certains chercheurs travaillent à intégrer des marqueurs invisibles dans les textes générés par IA, dès la production. Google et OpenAI investissent dans cette direction.

- La traçabilité des processus : plutôt que de détecter après coup, exiger une transparence sur la méthode de production (déclaration d'usage de l'IA).

- L'éducation critique : former les lecteurs, les enseignants, les journalistes à évaluer le fond plutôt que la forme — la vérifiabilité des faits, la cohérence des arguments, la présence de sources réelles.

La vraie question : à quoi sert encore l'authenticité ?

Au fond, la difficulté de détecter les textes IA nous force à une question plus profonde : pourquoi l'origine d'un texte nous importe-t-elle autant ? Est-ce une question de responsabilité ? De confiance ? D'identité ?

La réponse est probablement les trois à la fois. Un texte signé engage son auteur. Un article de presse porte une ligne éditoriale. Une lettre de motivation révèle une personnalité. Quand la machine peut imiter tout cela, c'est le pacte de confiance entre émetteur et récepteur qui vacille.

La détection des textes IA n'est pas seulement un problème technique. C'est un problème de société. Et pour l'instant, nous n'avons pas encore les outils — ni technologiques, ni culturels — pour y répondre pleinement. Ce qui rend la vigilance, plus que jamais, indispensable.

— Reservoir Live