Claude apprend en dormant : la révolution de l'entraînement continu

Et si la véritable intelligence se construisait la nuit ?

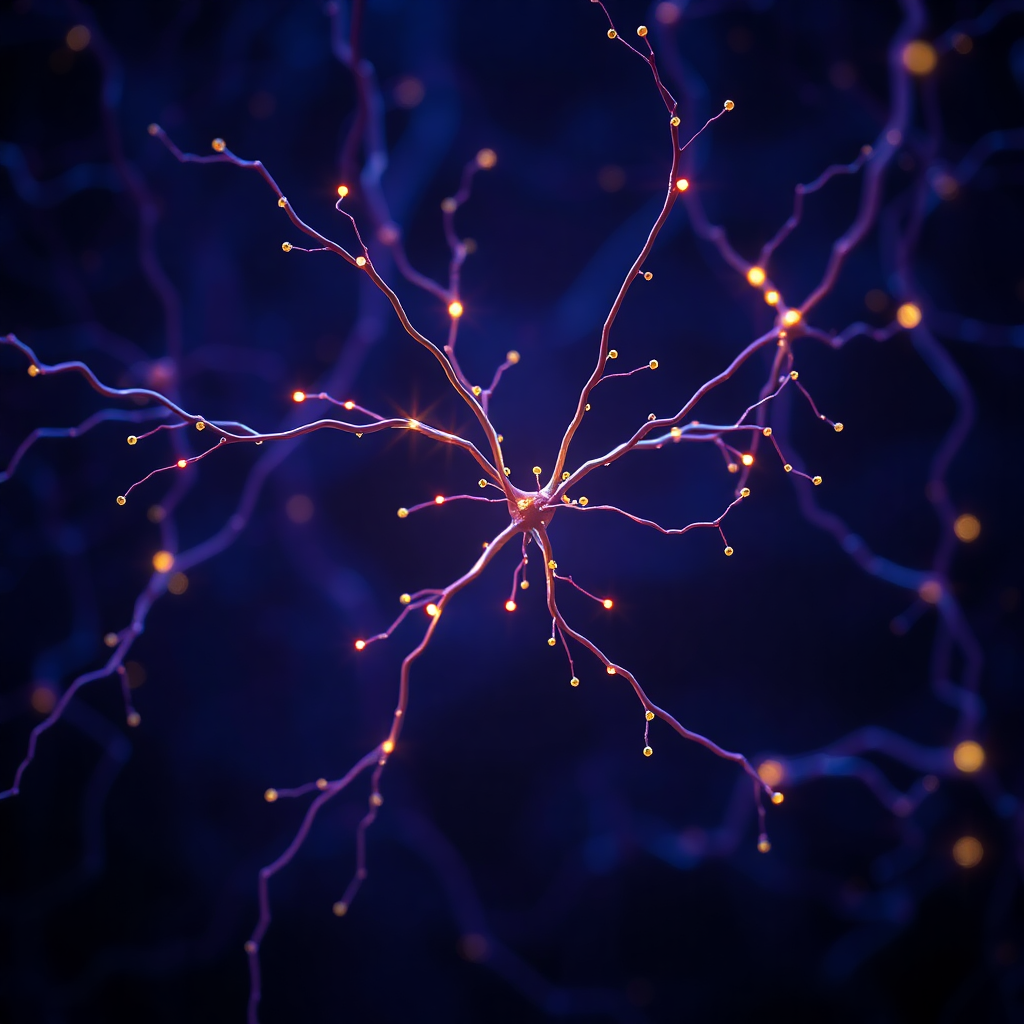

Vous avez peut-être déjà entendu que le sommeil consolide nos souvenirs, renforce nos apprentissages, restructure notre cerveau. Ce que les neurosciences ont découvert chez l'humain, les ingénieurs en intelligence artificielle cherchent aujourd'hui à reproduire à grande échelle. L'entraînement continu des modèles d'IA — et en particulier son application à des systèmes comme Claude d'Anthropic — représente l'une des avancées les plus silencieuses et pourtant les plus profondes de ces dernières années.

Derrière l'interface propre d'un chatbot se cache une mécanique d'apprentissage permanente, un cycle qui ne s'arrête jamais vraiment. Voici ce qu'il faut comprendre.

L'entraînement classique : une photo figée dans le temps

Pendant longtemps, les grands modèles de langage fonctionnaient selon un modèle simple : on entraîne, on déploie, on attend. Un modèle était formé sur d'immenses volumes de données jusqu'à une date précise — la fameuse date de coupure — puis figé. Il ne savait rien de ce qui s'était passé après. Interrogez GPT-3 sur un événement récent : il vous répondra avec la confiance tranquille de quelqu'un qui ignore tout de ce qu'il ignore.

Ce paradigme a ses avantages : la stabilité, la reproductibilité, la sécurité. Mais il a un défaut fondamental. Le monde, lui, ne s'arrête pas. Les lois changent, les sciences progressent, les usages évoluent. Un modèle statique vieillit mal — comme un dictionnaire dont la dernière édition date de dix ans.

L'entraînement continu : apprendre sans jamais s'arrêter

L'entraînement continu — ou continual learning en anglais — est une approche radicalement différente. L'idée : permettre à un modèle d'intégrer de nouvelles connaissances sans repartir de zéro, et sans effacer ce qu'il sait déjà.

C'est ici que la métaphore du sommeil prend tout son sens. Chez l'humain, la nuit ne sert pas qu'à récupérer : c'est un moment de consolidation active. Le cerveau trie, hiérarchise, efface ce qui est inutile, renforce ce qui est important. Les chercheurs en IA s'inspirent directement de ce mécanisme pour concevoir des cycles d'entraînement qui s'opèrent en arrière-plan, pendant que l'utilisateur, lui, dort.

Le problème de l'oubli catastrophique

Le principal défi technique de cette approche est redoutable : quand on expose un réseau de neurones artificiels à de nouvelles données, il a tendance à écraser ses connaissances antérieures. C'est ce qu'on appelle l'oubli catastrophique. Imaginez un expert en droit fiscal qui, après une semaine de formation en cardiologie, oublierait tout ce qu'il savait en fiscalité. Inutilisable.

Les solutions émergentes sont multiples :

- L'Elastic Weight Consolidation (EWC) : une technique qui identifie les connexions neuronales cruciales et les protège lors de nouvelles phases d'apprentissage.

- Le replay de mémoire : le modèle réintègre régulièrement des exemples de ses anciennes connaissances pour ne pas les perdre.

- Les architectures modulaires : chaque domaine de connaissance dispose de ses propres "modules" qui peuvent évoluer indépendamment.

Claude et l'ambition d'Anthropic : apprendre avec éthique

Anthropic, la société créatrice de Claude, ne s'intéresse pas seulement à la performance brute. Son approche de l'entraînement continu est indissociable de sa philosophie de l'IA constitutionnelle — un cadre qui intègre des valeurs humaines directement dans le processus d'apprentissage.

Concrètement, cela signifie que chaque cycle d'entraînement de Claude ne vise pas uniquement à le rendre plus précis ou plus rapide. Il vise à l'affiner selon des critères de sécurité, d'honnêteté et d'utilité. Claude "apprend en dormant", oui — mais il apprend aussi à mieux se comporter, à mieux calibrer ses réponses, à mieux détecter ses propres limites.

C'est une distinction capitale. Dans la course aux performances, il serait tentant de n'optimiser que les benchmarks. Anthropic fait le pari qu'un modèle aligné sur des valeurs stables sera plus durable — et plus utile à long terme.

Ce que cela change pour vous, utilisateur

Les implications concrètes de l'entraînement continu sont déjà visibles et vont s'amplifier :

- Des modèles toujours à jour, capables d'intégrer les dernières avancées scientifiques ou réglementaires.

- Une personnalisation plus fine, les systèmes pouvant s'adapter aux contextes spécifiques d'une industrie ou d'un usage.

- Une meilleure robustesse, les modèles apprenant de leurs erreurs en temps quasi-réel grâce aux retours des utilisateurs.

- Des enjeux de confidentialité accrus, car apprendre en continu implique de traiter des données récentes, ce qui pose des questions légitimes sur la vie privée.

Conclusion : l'intelligence qui ne dort jamais vraiment

L'entraînement continu n'est pas qu'une innovation technique. C'est un changement de paradigme profond sur ce qu'est un modèle d'IA : non plus un artefact figé, mais un système vivant, en perpétuelle évolution.

Claude qui "apprend en dormant", c'est une image séduisante — et assez juste. C'est la promesse d'une intelligence artificielle qui grandit avec le monde, qui affine ses jugements, qui consolide ses valeurs. Comme nous, la nuit venue.

La vraie question n'est plus de savoir si les IA peuvent apprendre en continu. Elles le font déjà. La question est : vers quoi les guidons-nous ?

— Reservoir Live